Dieser Inhalt wäre ohne die Premium-User nicht finanzierbar. Doch wir brauchen dringend mehr Unterstützer:

Hilf auch du mit!

Wie bereits vorhergesagt, brachte Nvidia am 22.3.2012 die ersten Grafikkarten mit der neuen "Kepler"-Architektur in den Handel – und damit auch in die Testlabore. Damit – so viel sei vorweggenommen – konnte sich AMD lediglich drei Monate im Ruhm des Leistungsführers sonnen. Denn die GTX 680 schlägt AMDs aktuelles Topmodell Radeon HD 7970 sowohl in den meisten Leistungsdisziplinen als auch bei der Energieffizienz. Grund genug, diese Ausgabe der GamersGlobal-Hardwarenews dem kalifornischen Hersteller und der Geforce GTX 680 zu widmen.

Teuer, schnell, sparsam im Verbrauch: Nvidia GTX 680 überzeugt in vielen Punkten

Teuer, schnell, sparsam im Verbrauch: Nvidia GTX 680 überzeugt in vielen Punkten

Überarbeitetes Innenleben

Bereits im Winter des vergangenen Jahres sollten erste Kepler-Grafikkarten auf den Markt kommen, pünktlich zum vorweihnachtlichen Benchmarkkampf mit AMDs Tahiti-Grafikkarte Radeon HD 7970. Offenbar gab es aber Probleme bei der Herstellung, so dass Nvidia erst drei Monate nach AMD ein funktionsfähiges Produkt vorstellen konnte. "Kepler" ist dabei der Entwicklungsname der GPU-Architektur, der auf der GTX 680 eingesetzte Grafikchip trägt die Bezeichnung GK104 - Geforce Kepler 104. Hergestellt wird die GPU in modernen 28-nm-Fertigungsstrukturen, was für eine gewisse Chip-Knappheit sorgt, da der Fertigungsprozess noch nicht vollends ausgereift zu sein scheint.

Im Vergleich zu den Fermi-Vorgängern hat sich bei Kepler einiges verändert, zahlreiche Anpassungen waren dringend nötig, um den teils extremen Energiebedarf der GTX400/500-Karten in den Griff zu bekommen. Am auffälligsten ist wohl der Anstieg der Shadereinheiten: Von 512 bei der GTX 580 auf 1536 Einheiten bei der GTX 680 – ein gewaltiger Sprung. Dennoch verdreifacht sich die Leistung der neuen Karte nicht, denn Nvidia musste auch versuchen, Energie zu sparen. Dafür wurde die sogenannte "Hot-Clock" entfernt. Bislang taktete die Shaderdomäne einer Geforce immer doppelt so schnell wie der restliche Chip. Das machte den Shadereinheiten ordentlich Beine, frass aber auch viel Energie. So lag der Chiptakt der GTX 580 bei 772 MHz, während die Shader mit 1544 MHz getaktet waren. Bei der GTX 680 herrscht ein einheitlicher Chip- und Shadertakt von 1006 MHz. Wobei die 1006 MHz wohl eine kleine Stichelei gegen AMD gewesen sein dürfte. Dort wurden einige HD7000-Modelle als "Gigahertz-Edition" beworben, auf den Chiptakt von 1 GHz war AMD also entsprechend stolz.

Ebenfalls gespart hat Nvidia beim Speicherinterface: War der GDDR5-Speicher bei der GTX 580 noch mit 384 Leitungen an die GPU angebunden, nutzt die GTX 680 nur noch ein Speicherinterface mit 256 Bit Breite. Ein schmaleres Speicherinterface bietet aber unter anderem den Vorteil, dass sich die Platinen preiswerter herstellen lassen. Um die verlorene Bandbreite auszugleichen, setzt Nvidia auf 3004 MHz schnelle Speichermodule mit insgesamt 2048 MB Kapazität. Die Speicherbandbreite sinkt durch den hohen Speichertakt nur minimal um wenige hundert Megahertz. Die zusätzlichen 1000 MHz beim Speichertakt sorgen also tatsächlich für einen fast vollwertigen Ausgleich. AMD steht mit 2750 MHz Speichertakt und 384 Bit Bandbreite bei der HD 7970 allerdings noch etwas besser da.

Übersicht aktueller Grafikchips

| Bezeichnung |

Radeon HD 7970 |

Geforce GTX 580 |

Geforce GTX 680 |

| Chip |

Tahiti |

GF110 |

GK104 |

| Chiptakt |

925 MHz |

772 MHz |

1006 MHz |

| Shadertakt |

925 MHz |

1544 MHz |

1006 MHz |

| Shadereinheiten |

2048 |

512 |

1536 |

| ROPs |

32 |

48 |

32 |

| TMUs |

128 |

64 |

128 |

| Speichermenge |

3072 MB GDDR5 |

1536 MB GDDR5 |

2048 MB GDDR5 |

| Speichertakt |

2750 MHz |

2004 MHz |

3004 MHz |

| Speicherbandbreite |

384 Bit |

384 Bit |

256 Bit |

| Energiebedarf |

max. 250 Watt |

max. 300 Watt |

max. 195 Watt |

| aktueller Preis |

ab ca. 441 Euro |

ab ca. 350 Euro |

ab ca. 477 Euro |

Der GPU-Name deutet es übrigens bereits an: Beim GK104 handelt es sich noch nicht um den Kepler-Vollausbau. Dieser soll in Form des GK110 erst im Herbst erscheinen und die Leistung der GTX 680 noch einmal stark übertreffen. Allerdings wird der GK110 mit Sicherheit kein Energiesparchip.

Wie die AMD-Konkurrenz nutzt die GTX 680 zahlreiche Features wie PCIe3.0 und DX11.1. Im Alltag relevant sind diese Funktionen jedoch vorerst nicht. DirectX11.1 erscheint erst im Herbst zusammen mit Windows 8 und wird nur wenige Änderungen zur Grafikschnittstelle hinzufügen. PCIe3.0 bietet zwar theoretisch die doppelte Bandbreite des Vorgängers PCIe2.0, diese wird von der Grafikkarte aber nicht benötigt wie zahlreiche Tests ergeben haben.

Wirklich neu im Grafikkartenmarkt ist die Einführung eines Turbo-Taktes für die GPU. Der Grafikchip der GTX 680 taktet im Normalfall mit 1006 MHz, kann aber unter gewissen Umständen auf bis zu 1058 MHz hochtakten. Wie auch bei Intels Core-i-Prozessoren hängt der Turbo mit der maximalen Leistungsaufnahme der Karte zusammen. Diese kann insgesamt 195 Watt betragen, Spiele lasten aber nur selten alle Funktionseinheiten so stark aus, dass die Karte auch tatsächlich 195 Watt benötigt. Bleibt hier also noch ein Spielraum, greift der Turbo und erhöht die Taktfrequenz der GPU um die Leistung auf diesem Weg zu erhöhen. Dabei steigert ein spezieller Chip nicht nur die reine Taktfrequenz, sondern hebt auch die Spannung der GPU an um einen stabilen Turbo-Betrieb zu ermöglichen. Aktuell liegt die Turbo-Ausbeute auf eher niedrigem Niveau, Custom-Karten anderer Hersteller könnten hier aber stärkere Unterschiede ermöglichen. Auch sind die 1058 MHz nur ein von Nvidia genannter Durchschnittswert, der Turbo kann in gewissen Situationen auch mehr als 1100 MHz nur durch den Turbo erreichen. Wer aber lieber Energie sparen möchte anstatt Leistung zu gewinnen, kann das sogenannte Power Target mittels Zusatz-Tools auch stark absenken, so dass die Karte automatisch ihren Takt reduziert. Im Gegensatz zu anderen Über- oder Untertaktungsoptionen hat Nvidias Turbo zudem einen entscheidenden Vorteil: Bei der Nutzung des Turbos geht die Garantie der Karte nicht verloren.

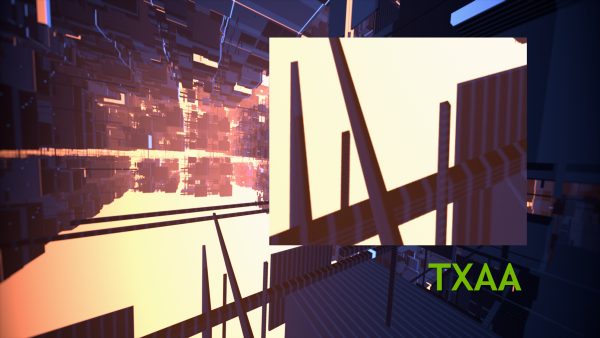

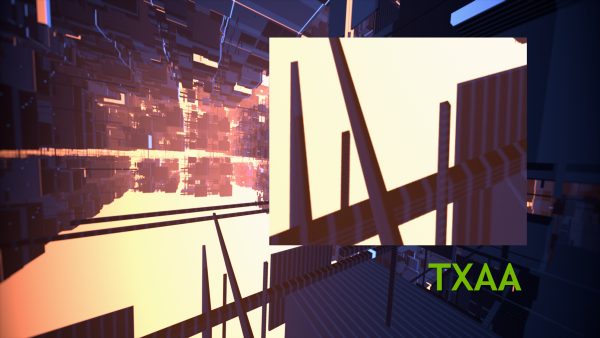

Mit TXAA hält ein neuer und offenbar durchaus überzeugender Kantenglättungsmodus Einzug

Mit TXAA hält ein neuer und offenbar durchaus überzeugender Kantenglättungsmodus Einzug

Neue Kantenglättungsfunktionen und andere Features

Bis zur Vorstellung von AMDs aktuellen GCN-Grafikkarten (auf der Graphics-Core-Next-Architektur basieren die aktuellen HD7000-Modelle) lag Nvidia dem Konkurrenten bei der Bildqualität weit voraus. Einige Verbesserungen bei den neuen Karten sorgten jedoch für einen Gleichstand oder sogar eine kleine Überlegenheit für AMD in puncto Bildqualität. Nvidia kontert nun mit einem neuen Kantenglättungsmodus namens TXAA, der zwei bereits bekannte Kantenglättungstechniken kombiniert und eine schnelle und dennoch überzeugende Geometriekantenglättung ermöglicht.

Bislang gibt es allerdings noch keine realen Anwendungen für TXAA, da das jeweilige Programm den Kantenglättungsmodus selbst anfordern muss – eine Aktivierung im Treiber reicht also nicht. Die von Nvidia zur Verfügung gestellten Beispielscreenshots einer TXAA-Demonstration zeigen allerdings beeindruckende Ergebnisse, so dass zu hoffen bleibt, dass viele Hersteller TXAA in ihre Spiele integrieren werden. Vor allem, da TXAA im Vergleich zu anderen hochwertigen Kantenglättungsoptionen wie MSAA deutlich schneller arbeitet und sogar eine bessere Bildqualität liefert.

Ein weiterer Punkt, in dem sich AMD seit einiger Zeit von Nvidia abheben konnte, war die bei AMD "Eyefinity" genannte Multi-Monitor-Lösung. So war es möglich, mit jeder AMD-Grafikkarte seit der HD-5000-Serie mindestens drei Monitore gleichzeitig anzuschließen. Auch Surround-Gaming mit mehreren Bildschirmen war damit möglich, der Treiber rechnete die Auflösungen zu einem großen Gesamtbild zusammen. AMDs Topmodelle unterstützen sogar bis zu sechs Monitore gleichzeitig. Nvidia zieht mit Kepler nach und ermöglicht mit der GTX 680 die Nutzung von vier Bildschirmen an einer Karte.

Der Vorteil gegenüber der AMD-Lösung: Bei Nvidia funktioniert es mit beliebigen Monitoranschlüssen, während bei AMD nur zwei Bildschirme via HDMI, VGA oder DVI verbunden werden konnten und alle weiteren zwingend Displayport nutzen mussten. Zudem bietet Nvidia auch die Möglichkeit, auf allen drei Bildschirmen in Surround-3D zu spielen – wenn denn die Leistung dafür ausreicht.

Ebenfalls neu ist die NVENC genannte Videoeinheit, mit der sich Videos schneller als über die Shadereinheiten transcodieren lassen. Neben der größeren Geschwindigkeit soll zudem die Leistungsaufnahme beim Transcodieren gesenkt werden. Auf Wunsch soll die NVENC-Einheit auch zusammen mit den Shadereinheiten genutzt werden können, was die Leistung noch weiter steigern kann. Allerdings muss die Funktion explizit von den Anwendungen unterstützt werden, beschleunigt also keine bestehenden Videotools. Bislang bietet Cyberlink eine Betaversion von MediaEspresso mit NVENC-Unterstützung.

Performance - Top bis 1920 x 1080

Die gute Nachricht: In der wohl am weitesten verbreiteten Auflösung 1920 x 1080, landläufig auch als FullHD bezeichnet, schlägt Nvidias GTX 680 nicht nur den eigenen Vorgänger sondern auch AMDs HD 7970 problemlos. In den Tests von Computerbase lag die Kepler-Karte mit 4xAA/16xAF um 9 Prozent vor AMDs Tahiti-Modell und 25 Prozent vor der GTX 580. Sogar die beiden Dual-GPU-Karten HD 6990 und GTX 590 sind nur minimal schneller als Nvidias Neuzugang. Etwas schlechter sieht es bei 2560 x 1600 Bildpunkten aus, der Auflösung teurer 27-Zoll-Bildschirme: Nvidia kann sich nur knapp vor AMD setzen, die GTX 580 hängt die GTX 680 aber dennoch um 26 Prozent ab.

In den Einzeldisziplinen zeigt sich, dass AMD bei Spielen wie Anno 2070 etwas die Nase vorn hat, hier kann die HD 7970 die GTX 680 in 1920 x 1080 um gute 10 Prozent abhängen. Das leistungshungrige Battlefield 3 jedoch bleibt Nvidia-Domäne: Fast 20 Prozent Vorsprung für die GTX 680 in 1920 x 1080 mit 4XAA/FXAA sowie 16xAF sprechen für sich. Metro 2033 jedoch präferiert AMD und läuft auf der HD 7970 gute 23 Prozent schneller als auf der Nvidia-Karte.

Bei sehr hohen Auflösungen wie sie beim Surround-Gaming genutzt werden, geht der GTX 680 zudem der Grafikspeicher aus, hier rächt sich die konservative Bestückung mit nur 2048 MB im Referenzdesign. Zwar stellen erste Hersteller bereits Modelle mit 4096 MB in Aussicht, der schlechte Eindruck jedoch bleibt und macht ein wenig das Highend-Gefühl kaputt.

Der GK104 besteht aus 3,54 Mrd. Transistoren und fällt damit kleiner aus als AMDs Tahiti-GPU (4,3 Mrd. Transistoren)

Lautstärke und Energieaufnahme: Vorbildlich

Der GK104 besteht aus 3,54 Mrd. Transistoren und fällt damit kleiner aus als AMDs Tahiti-GPU (4,3 Mrd. Transistoren)

Lautstärke und Energieaufnahme: Vorbildlich

Das Referenzdesign von AMDs Radeon HD 7970 tönt mit bis zu 5 Sone im Spielealltag viel zu laut vor sich hin, so dass hier berechtigte Kritik aufkam - auch wenn zahlreiche Hersteller diesen Punkt mit ihren eigenen Lüfterkonstruktionen zufriedenstellend verbessert haben. Nvidias GTX 680 jedoch zeigt sich selbst im Referenzdesign vergleichweise ruhig und erreicht nur etwa 3 Sone - für Silent-Fans ist dieser Wert zwar immer noch viel zu hoch, im Vergleich zum AMD-Lüfter aber eine extreme Verbesserung. Aus einem geschlossenen PC lässt sich die GTX 680 im Idle nur noch mit Mühe heraushören. Angesichts der deutlich geringeren Energieaufnahme der Nvidia-Karte dürften Custom-Lüfter eventuell sogar Ruhefanatiker zufrieden stellen.

Generell hält sich der Energiebedarf der GTX 680 vornehm zurück. Unter Last erreicht die Karte nur selten ihr theoretisches Maximum von 195 Watt, im Schnitt liegt die Karten bei 165 Watt. Ein klarer Vorteil gegenüber AMD, deren HD 7970 bis zu 50 Watt mehr aufnimmt - was beim Erscheinen der Karte allerdings ebenfalls als Erfolg bei der Energiebilanz gefeiert wurde! Im Gegensatz zu AMDs Topmodell, welches für die Stromversorgung einen 6-Pin und einen 8-Pin-Stromstecker vom Netzteil benötigt, kommt Nvidias GTX 680 mit zwei 6-Pin-Steckern aus. Unter Umständen werden übertaktungsfreudige Boardpartner aber dennoch Modelle für größere Energieaufnahmen konstruieren - erste Hersteller sprechen bereits von beeindruckenden 2 Gigahertz Chiptakt für OC-Modelle. Im Idle, also immer, wenn die Karte gerade keine aufwändigen Berechnungen stemmen muss, liegt die Leistungsaufnahme bei nur etwa 14 Watt, ebenfalls ein beeindruckend niedriger Wert.

Teuer aber durchdacht

Eines ist klar: Bei einem Preis von etwas weniger als 500 Euro ist die GTX 680 keine Karte für den 0815-Zocker oder preisbewusste Gamer. Nvidias Kepler-Erstlingswerk macht dafür aber auch so gut wie alles richtig und zeigt nur einige kleinere Schwächen im Detail. Sowohl die stark gesenkte Energieaufnahme bei gleichzeitig stark gesteigerter Leistung gegenüber dem hauseigenen Vorgänger GTX 580 und sogar gegenüber AMDs für drei Monate ebenfalls als effizient betitelte HD 7970 als auch die Lautstärke mit dem Referenzlüfter sprechen für Nvidia. Mit nur 195 Watt bietet die GTX 680 ein Grafikfeuerwerk mit beeindruckenden Leistungen und einem auf den ersten Blick sehr überzeugenden neuen Kantenglättungsverfahren. In der gängigen FullHD-Auflösung wird AMDs Topmodell problemlos geschlagen, wenngleich der Leistungsvorsprung geringer ausfällt, als so mancher Nvidia-Fan erwartet hätte. Dafür hat Nvidia mit dem GK110 noch einen Trumpf in der Hinterhand, bei der GTX 680 handelt es sich immerhin nicht um das Topmodell der Serie sondern "nur" um ein leistungsstarkes Performance-Modell, vergleichbar mit der Radeon HD 7870.

Praktisch ist die endlich eingeführte Multimonitor-Unterstützung für vier Bildschirme, vorbildlich die Umsetzung ohne Displayport-Zwang und mit Surround-Gaming in 3D. Bedauerlich hingegen ist die in hohen Auflösungen stark abfallende Performance durch den knauserig wirkenden Speicherausbau. In 5760 x 1080 fehlt es der Karte massiv an VRAM und auch ein wenig an Speicherbandbreite gegenüber AMDs in diesem Punkt glänzender HD 7970.

Für viele PC-Gamer dürfte mit der GTX 680 das Warten allerdings erst beginnen, immerhin zeichnen sich aufgrund der durchdachten Kepler-Architektur spannende Mittelklassemodelle ab, die zu (voraussichtlich) bezahlbaren Preisen mit viel Leistung und geringem Stromverbrauch punkten werden. Eine potentielle GTX 660 TI hat damit das Potential zum Klassiker - zumindest wenn Nvidia den Rotstift nicht an den falschen Stellen ansetzt und die Architektur gut nach unten skaliert. AMD zeigt sich mit der HD-7000-Serie zwar gut aufgestellt, kann mit Nvidias verspätetem Konter jedoch aktuell nicht mithalten.

Ich weiß net so recht...so lange wir Konsolenports bekommen oder Spiele auf dem Grafikniveau von BF3 reicht die 68XX Ati oder Nvidias 550 TI und besser eigentlich locker aus. Jedenfalls bis 1080p und das kann ja der Großteil der Monitore auch nur max.

660 TI könnte ein Hammer werden, aber ob sich da ein Upgrade von einer 560 TI wirklich atm lohnt wage ich zu bezweifeln. Mal abwarten ^^ Freundin hat meine MSI schon seit dem Kauf im Auge *gg* und wenn MSI wieder so ne Twin Frozer der 660 TI bringt mit guten Preis könnte man ja doch schwach werden.

Zumindest die etwas kleineren Modelle könnten sehr spannend werden. Und wem gerade seine 8800GT abgeraucht ist, der freut sich sicher auch über was brauchbares aktuelles. Ich zum Beispiel freue mich über mehr Leistung, da meine 460 bei Spielen in 3D doch arg schwächelt. So eine 660 (TI?) wäre schon nett wenn sie in der Leistungs-Tratition der x60-Karten verbleibt..

Nicht wenn die 8800 GT von EVGA ist. (10 Jahre Garantie)

Bei einer Auflösung von 1280 x 1024 ~ 1.3 MP reicht mir die Leistung noch vollkommen.

Was wäre den eine adäquate Alternative zur 8800 GT? Eine 640? Der einzige Vorteil der neuen Genration dürfte wohl der geringere Stromverbrauch (passive Kühlung) gegenüber der GT sein. DX 11 und Bildverbesserungsprogramme spielen in der Liga wohl keine entscheidende Rolle.

Naja, so'n neuer Monitor ist ja auch was nettes oder? Und dann mit 1920 x 1080.. ;)

Wie es in den unteren Kepler-Segmenten aussieht, ist ja noch nicht bekannt. Ob in der Einstiegsklasse nur alte GPUs verwertet werden oder wirklich neue Modelle kommen - wer weiß. Bei den Notebook-Chips setzen erst einmal nur die Mittelklassemodelle auf Kepler, da wird es wohl auch vorerst keine Kepler-Einstiegsversionen geben.

Was ist die adäquate Alternative zur 8800GT? Immer das, was man sich leisten möchte. Gerade in kleinen Auflösungen sieht Kantenglättung gut aus, eine potentielle 660 oder wenn sie kommt eine 650 wäre da dann nicht überdimensioniert.

*werbung mach* ^^

http://www.kmcomputer.de/item/0/0/0/304254/60.96cm-24zoll-asus-vh242t-1920x1080-dvivga.html

*ggg*

Ja, stecke ohnehin in einer Zwickmühle. 24 Zöller wäre nicht schlecht. Nur setzt das eine Kettenreaktion in Gange, die ich mir "kurz" vor dem erscheinen der neuen Konsolengeneration nicht leisten möchte. Neben einer neuen GPU wird auch eine neue CPU gebraucht, die wiederum die GPU nicht übervorteilt. Und die CPU setzt wiederum andere neue Komponenten im PC voraus. Aber wem erzähle ich das. :D

Ein aufrüsten von 19" auf 24" ist demnach nicht ganz so günstig. Daher hatte ich mir gesagt, dass ich das mit der neuen Konsolengeneration verbinden werde, bei der ich ohnehin einen neuen PC bräuchte. Solange darf die 8800 GT von EVGA ruhig noch etwas weiter ackern.

"Kettenreaktion"... schön gesagt! :)

Ich denke, der Schwachpunkt deiner Argumentationskette (wie du es ja selber auch andeutest) liegt im "baldigen" Erscheinen der neuen Konsolengeneration. "Bald" ist ein sehr dehnbarer Begriff und wenn, die WiiU mal außen vor, die neuen Konsolen vielleicht erst 2015 erscheinen, wäre genau jetzt der ideale Zeitpunkt zum Aufrüsten.

Hardware "News" sind das ja nicht gerade...

Aber seis drum. Ich warte derzeit nur noch, dass Zotac oder MSI die Karte mit Customkühler bringen, dann ist sie gekauft.

Wer braucht heute bitte noch ne neue Graka??

PC Spiele werden selbst die nächsten Jahre eh keine Spiele mit grandioser Grafik (inklusiver Artdesign) wie Uncharted oder Journey haben... und was rein realistische Grafik angeht, werden Spiele auch in den nächsten 5 Jahren nicht besser aussehen als Battlefield 3. Und das läuft in 1080p in maximum mit meiner 2 Jahre alten Karte flüssig.

Bitte ab sofort endlich mal auf Animationen und Gesichter konzentrieren.

5 Jahre da kann sich gewaltig was ändern aber egal. Die Gtx 680 ist genau das was sie sein sollte aber was mich stört ist es ist eigentlich keine GTX680 sondern eine GTX 660. Ich wart ab bis der vollausbau kommt und kauf mir dann eine richtige GTX 770.

Und es gibt einige Spiele die bringen meine Karte an ihre grenzen ist GTX570 @847/2300 und GW2 wird denke ich auch so einfall sein. Oder Bf3 auf max die neuen maps da gehen die FPS sehr nahe an die 25 runter wenns kracht. Oder Rift mit supersampling ach es gibt echt genung wo man auf Full HD eine Karte an die grenzen bringen kann.

Und Bf3 läuft bei dir flüssig bei einer 2Jahre alten Kiste schon mal überhaupt flüssig gespielt wenn das flüssig sein soll? Singelplayer vieleicht aber mulit ist mal ganz was anderes.

"5 Jahre da kann sich gewaltig was ändern"

Du meinst so "gewaltige" Veränderung wie seit Crysis das vor 5 Jahren erschien? Wow! Noch so 5 Jahre und meine bald 3 Jahre alte 5850 kann das in Rente gehen wohl vergessen. Gar 10 weitere so Jahre und wir wären wieder bei N64 Grafik angekommen!

Erstmal wieder toller Artikel.

Also ich hab zur Zeit eine GTX570 im Rechner die mehr als genug Leistung in 1920*1080 bringt sollte die nicht mehr ausreichen wäre eine GTX 670 (wenn sie denn so heisst) angebracht.

Schlimm, dass es aktuell nicht einmal Spiele gibt, die die letzten Generationen richtig auslastet *g*. Meine SLI-GeForce 580 langweilt sich in meinem PC genauso wie sogar eine GeForce 485M in meinem Laptop. Bisher kein Spiel gehabt, was irgendwie auf maximaler Auflösung und Details ruckelt oder zumindest in die Nähe kommt. Habe das auf dem PC nur, wenn diverse Spiele nicht auf Auflösungen wie 2560x1440 bestimmt sind und dort wegen schlechter Programmierung für solche Auflösungen einen rabiaten Leistungsverlust haben. Deus Ex HR war so ein Spiel, was auf hohen Auflösungen einen unerklärlichen Leistungsverlust hatte, mittlerweile haben die das zum Glück gepatcht :)

Jep, das gabs noch nie, das ein 2 Jahre alter Rechner noch sowas von technisch "State of the Art" ist... Ich sehe auch in nächster Zeit keinen Grund meine 570 GTX auszutauschen.

Endlich mal was positives von der Konsolenportierungsfraktion ;-)

Früher hast du ja zu jedem neuen Wing Commander einen neuen Rechner gebraucht ;-)

War trotzdem spannend, da gabs wenigstens noch Fortschritt. Wenn ich heute in Hardwareforen lese, habe ich oft das Gefühl mit meiner Oma zu diskutieren. "Kind, damals kamen wir auch ohne Autos aus, das geht alles viel zu schnell mit dem Fortschritt. Lass mal gut sein, so was neumodisches."

Ich kann Dich verstehen, was die Technikbegeisterung angeht. Die ist scheinbar gesellschaftlich etwas eingeschlafen. Mit einem Weltraumprogramm zum Mars lockt man genauso wenig die Leute vom Fernseher weg, wie mit einer neuen Graka. Die Bequemlichkeit sowohl physisch als auch psychisch hat den Sieg davon getragen. Für den Fortschritt ist das natürlich von Nachteil.

Ich glaube aber das ist nur in den "satten" westeuropäischen Ländern und Amerika so. Aufbruchsländer wie in Asien oder Osteuropa mit dynamischen Geistern und Menschen, die noch "hungrig" sind, wachsen ganz anders auf, erleben und fordern Fortschritt viel mehr.

Achso, der Artikel war super :)

Früher hat man sich auch PC Magazine gekauft und war begeistert von der Grafik und hat jeden Screenshot genau angeguckt, das war immer recht magisch. Mittlerweile konsumiere ich Screenshots von Magazinen so gut wie gar nicht mehr, bzw eher inhaltlich als grafisch, weil diese sogar schlechter aussehen als bei mir daheim...

dennis ziesecke, wieso führst du nicht selbst benchmarks durch, sondern bedienst dich fleissig bei anderen?

Anonymer, warum suchst du dir nicht ein Leben oder Feinde in der unmittelbaren Umgebung anstatt Leute im Internet anzugehen? Ist dir wohl zu riskant, was?

Das war eine ganz normale frage, wieso kannst du nicht normal darauf antworten?

Weil es jedem klar sein dürfte, dass unbezahlte GG-Freiwillige (ja, das bin ich in diesem Falle tatsächlich) keine Testmuster von NV bekommen. Und schnell mal so eine Karte für einen kostenlos eingestellten Bericht kaufen? Mach du mal bitte. Oder ein paar Monate auf ein Testexemplar warten? Wo sich ja nach ein paar Tagen Verzögerung schon Leute über die mangelnde Aktualität beschweren? Zumal die Quellen angegeben sind - wo ist das Problem?

Da all das mit nur minimalem Nachdenken herauszufinden ist, sehe ich den Beitrag als das, was er sicherlich war: Ein ungeschickter Trollversuch.

Weil genau das nicht in deinem Artikel rüberkommt. Was spricht gegen ein simples "die Tester von Gamestar sind zu folgendem Ergebnis gekommen" in deinem Text. Wer sich die Quelle nicht durchliest bekommt den Eindruck, als sei das Fazit von dir persönlich. Und das finde ich bedenklich...

Ich warte auf den Tag, an dem unter deinem Artikel mal keine Quellangabe steht, sondern einzig und allein du der geistige Urheber des Textes bist...

Hast du den Kurztest zum Lenovo Thinkpad Edge E520 gelesen? Offenbar nicht, sonst würdest du nicht mehr unnötig warten. Quellen werde ich aber weiterhin angeben - und sei es die Herstellerseite, auf der technische Informationen nachzuschlagen sind.

Ansonsten: Siehe unten. Was ist an "In den Tests von Computerbase.." so missverständlich?

Doch, den Artikel kenne ich. Glückwunsch, seit 18.05.2011 ist also kein Artikel deinem Kopf entsprungen, wirklich beeindruckend.

Wenn du nicht ganz so borniert wärst, hättest du die CeBIT-Berichterstattung gefunden. Aber deine Argumentation wirft ein sehr eindeutiges Licht auf dich. Kein gutes übrigens.

Sag mal, was bist du denn fürn Vogel? Warum greifst du den Typen hier so an? Hat der dir mal ne Frau ausgespannt? Die News sind toll, gut geschrieben und eindeutig auch selbst verfasst, nur mit den genannten Seiten als Quelle.... Wo issn dein Probelm?

du hast den text aber schon ganz gelesen bevor du mit dem motzen angefangen hast oder? wenn nich dann machs mal....

Das interessiert mich jetzt ernsthaft: hast du die Hardware selbst getestet und bist du alleine zu dem Fazit gekommen, oder beruht dein Artikel auf den Messergebnissen von Gamestar?

Es sind die Messergebnisse von Gamestar, heise, Computerbase und zahlreichen anderen Redaktionen, die mit einem Testmuster versehen waren. Dass ich die Karte selbst getestet habe, steht in keinem Wort im Text und wird auch nicht angedeutet - nur um unterschwelligen Vorwürfen vorzubeugen. Dass der Text neben den von Nvidia per Pressemitteilung und auf der Webseite herausgegebenen technischen Daten auf auf Benchmarkergebnissen anderer Magazine basiert sollte aus Sätze wie "In den Tests von Computerbase lag die Kepler-Karte.." und die Quellenangaben hervorgehen.

Mit den großen Karten kann ich nix mehr anfangen. Ich bin mal auf die mobile Version(en) gespannt; ob da z.B die Hardware Tesselation auch in brauchbarer Geschwindigkeit läuft, etc.